Mediakwest : Pouvez-vous nous en dire plus sur l’acquisition de Mettle par Adobe ?

Bill Roberts : Il faut inscrire cette évolution dans son contexte : nous avons commencé la VR très tôt, parce que l’architecture de Premiere permettait de traiter des images équirectangulaires de grande taille, en 5K ou en 8K. Les pionniers de la VR ont donc commencé à travailler sur Premiere, et nous nous sommes adaptés, en permettant l’affichage à un angle de 115 ° ou de 120 °, en veillant à offrir des fonctions de visionnage en stéréoscopie et en 2D, etc.

La première étape était de nous assurer que les contenus étaient entièrement pris en charge. Puis, l’an dernier, nous avons remarqué une forte croissance de l’utilisation de la VR. Dans l’univers du broadcast – je précise qu’il ne s’agit pas de chiffres officiels –, nous sommes passés de 25 % des professionnels ayant des projets en VR à 75 %. En regardant notre feuille de route, on peut voir que presque tous les ingrédients étaient là dès le début : la vidéo, les sons immersifs ambisoniques (que nous avons ajoutés au printemps), la publication sur YouTube et Facebook… mais pour raconter une histoire de A à Z, il fallait encore des fonctions de transition, d’effets spéciaux, et de titrage. Sur ces trois éléments, c’étaient nos clients qui avaient une longueur d’avance sur nous ! Il fallait faire quelque chose.

Nous avions une relation longue et fructueuse avec Mettle depuis des années, et nous avons commencé à parler avec son fondateur, Chris Bobotis, de la direction qu’il souhaitait prendre pour son entreprise. Il avait beaucoup de succès avec nos produits, et il en était arrivé au stade où il devait choisir entre agrandir son entreprise et envisager une autre voie. Alors je lui ai dit : « Viens travailler avec nos produits en interne, ça sera plus facile ! » C’est une conversation que nous avons commencée vers le mois de février dernier. Il a fallu un peu de temps pour tout mettre en place, mais c’était une combinaison idéale de talents.

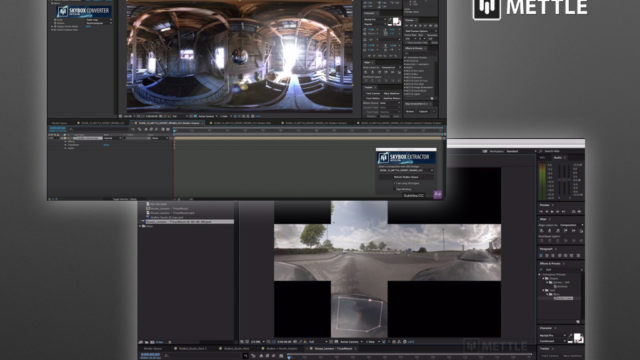

Du point de vue technologique, Chris et l’équipe de Mettle avaient utilisé nos API pour accéder à la puissance de la carte graphique, indispensable pour traiter des images aussi volumineuses. Nous avons ainsi acquis une certaine avance technologique que nous sommes en train d’intégrer dans nos propres solutions, et nous avons surtout gagné de nouveaux talents : Chris a une vision très claire de l’avenir de la VR à 360° et de son intégration dans l’univers plus général de la VR. Il travaille donc à présent comme directeur des technologies immersives, au sein de ma propre équipe, mais il collabore également avec Adobe Research et d’autres départements chez Adobe. Chris travaillera à l’unification de la photo à 360°, de la vidéo à 360° et de nos projets en AR ; nous avons par ailleurs embauché des experts qui ont une connaissance profonde des processeurs graphiques et du fonctionnement des images à 360°. En effet, presque toutes les technologies actuellement présentes dans Premiere sont basées sur la notion de caméra fixe, pas immersive.

Chris s’est adapté à merveille ; dès le premier jour, il a été très actif lors des réunions et a lancé de nombreuses réflexions sur notre avenir. Un de nos chantiers en cours, par exemple, est le compositing en 3D. Nous sommes naturellement influencés par la conférence de Facebook, lors de laquelle nous avons annoncé la compatibilité avec les caméras virtuelles à six degrés de liberté. Et puis la semaine dernière, lors du salon VidCon, Google/YouTube a également annoncé son propre format 180 ° stéréoscopique. Ces deux approches sont différentes, mais elles cherchent à ajouter de la profondeur aux images « plates » en VR à 360°. Pour nous, la prochaine étape est donc une réflexion sur la profondeur, et nous allons évoluer vers un environnement entièrement en 3D : je pense que les prochaines caméras enregistreront non seulement des images en 2D, mais également la géométrie de la pièce où les images ont été filmées.

M. : J’ai lu, il y a quelques années, un article scientifique sur les recherches d’Adobe sur la technologie Lightfield, où en est ce projet ?

B.R. : À la même période que l’annonce concernant Facebook, à savoir la capture d’images avec six degrés de liberté, notre équipe de recherche (dirigée par Gavin Miller) a présenté un article sur la création d’une caméra virtuelle à six degrés de liberté à partir d’une image plane. Je pense que c’est un domaine très prometteur, à la fois pour la capture et pour la dérivation à partir d’une image fixe. Bien sûr, plus on peut capturer d’informations dans une image, plus il est facile d’obtenir des images de très haute fidélité et donc des résultats de qualité. L’avenir nous réserve beaucoup de surprises, et de nombreuses recherches sont en cours.

M. : Maintenant, Mettle continuera-t-elle de vendre ses plugins ?

B.R. : Cela fait longtemps que Mettle développe des solutions en tandem avec l’équipe After Effects, et ce qui nous intéressait vraiment c’était la technologie SkyBox. Donc nous avons acquis toutes les technologies liées à la VR à 360°, mais Mettle continue d’exister en tant qu’entreprise à part entière. Nancy Eperjesy continuera de diriger et de faire évoluer Mettle, qui sera un partenaire d’Adobe et donc l’activité se concentrera sur le traitement d’images et sur les plugins pour After Effects.

En général, nous disons à nos partenaires : « Voici sur quoi nous travaillons, et voilà sur quoi nous ne travaillons pas », ce qui leur permet de décider où concentrer leurs efforts. Mettle ne travaillera pas sur les technologies de VR à 360°, car nous ferons cela en interne. C’est une bonne démarche à mon avis, car ça ne sert à rien d’acheter une entreprise tout entière lorsqu’on n’est intéressé que par un volet précis de son activité. Nancy est également très enthousiaste, et elle a déjà commencé à mettre au point une nouvelle feuille de route pour Mettle.

M. : Comment voyez-vous la position d’Adobe sur le marché du film et du documentaire ?

B.R. : Les divers marchés du cinéma dans le monde, y compris le cinéma hollywoodien, ne sont pas en grande forme pour ce qui est du nombre de places vendues. En revanche, c’est un marché extraordinaire en termes de talent : nous travaillons avec des créatifs qui poussent la technologie dans ses derniers retranchements et nous aident à améliorer nos produits, ce qui se répercute sur les utilisations grand public.

Et en plus des améliorations technologiques que nous mettons en place chez Adobe, l’inspiration est très importante. En effet, les créateurs en herbe souhaitent utiliser les mêmes outils que les vétérans du secteur. Nous sommes donc très impliqués dans ce secteur, et collaborons avec Hollywood pour que nos produits soient en mesure de créer des films de tête d’affiche, ce à quoi nous sommes parvenus il y a environ trois ans. Cette année, nous avons même installé des bureaux à Hollywood pour déployer une équipe d’ingénieurs.

Nous travaillons également avec tout un réseau d’autres entreprises avec lesquelles nous pouvons prendre en charge même les films les plus ambitieux et assurer leur succès. Nous ajoutons également à nos solutions de nouvelles fonctions qui correspondent aux besoins des studios, et que nous avons présentées en avant-première lors de la dernière réunion de l’ACE (Association des monteurs cinéma).

Nous ciblons de manière très précise les workflows uniques que nous voyons utilisés entre les assistants monteurs et les monteurs principaux. Ce sont des enjeux importants, mais il ne faut pas chercher à avancer trop vite quand la technologie ne suit pas. Dans le cinéma actuel, la time-line a beaucoup plus de couches ; par exemple, les effets visuels ne sont plus une simple couche plate, mais ils incluent énormément d’informations de compositing. La piste audio est créée avec Pro Tools, mais maintenant tout est dynamique et lié. Voilà notre valeur ajoutée pour Hollywood : on peut encore faire des changements jusqu’à la dernière minute.

Nous sommes en train de finir le travail sur un film qui sortira en octobre, Only the Brave, monté par Billy Fox, et le studio a particulièrement apprécié la possibilité de générer ses propres DCP, ce qui leur a évité des allers-retours et fait gagner beaucoup de temps. À mesure que les clients découvrent nos solutions, ils y voient donc différents atouts en fonction de leurs besoins spécifiques.

M. : Avez-vous identifié un marché particulièrement prometteur ?

B.R. : Nous avons eu beaucoup de chance, car en tant que développeur de logiciels nous avons pu fédérer beaucoup d’indépendants lors de la phase initiale de notre croissance. Depuis une dizaine d’années, notre plus forte croissance se fait sur le marché du broadcast : il y a une deuxième vague d’investissement dans le numérique, avec des workflows hybrides répartis entre plusieurs sites ou encore des besoins de gestion sur mesure des contenus média. Notre activité se porte donc particulièrement bien grâce au broadcast, mais la production de films et de séries est également très importante en ce moment, ce qui a des retombées positives.

Un domaine dans lequel nous avons encore de la marge de progression, et pour lequel nous préparons des nouveautés à l’automne, c’est celui des plates-formes numériques comme YouTube et Facebook. C’est un secteur qui connaît une croissance fulgurante, et de nombreux créatifs dans cette première phase explosive utilisent d’autres solutions pour leurs contenus, ne trouvant pas dans Adobe Spark et Premiere Clip le niveau de fidélité qu’ils souhaitent pour leurs œuvres.

Mais il y a justement beaucoup de potentiel, comme nous l’avons vu la semaine dernière lors du salon VidCon à Anaheim : des enfants de 12 ou 13 ans racontent des histoires passionnantes, ils sont très sensibles à la notion de branding, et ils comprennent également très bien les aspects analytiques des solutions Adobe. Qui regarde ma production ? Mon histoire parle-t-elle à mon public ? Et ainsi de suite. En écoutant ces jeunes, on a vraiment l’impression d’entendre des professionnels du broadcast, à leur manière de vouloir séduire et fidéliser un public. Ces nouvelles plates-formes sont donc un extraordinaire nouveau territoire à conquérir, avec un potentiel de croissance énorme.

De manière plus générale, nous sommes à l’ère de la vidéo. Adobe a connu trois phases de croissance : le texte, avec des polices destinées aux imprimantes, puis la photographie numérique, et maintenant c’est la vidéo. Par exemple, les entreprises n’impriment plus de manuels de réparation, elles préfèrent produire une vidéo qu’elles publient sur YouTube. Pour autant, il s’agit de créateurs dont ce n’est pas nécessairement le métier, et nous pouvons les aider à produire de bons résultats.

M. : Doit-on alors attendre un nouveau produit Adobe qui réponde à ce besoin ?

B.R. : Tout ce que je peux dire, c’est que l’automne s’annonce très prometteur !

M. : Quels sont projets pour le Creative Cloud ? Avez-vous prévu de nouvelles fonctions intéressantes ?

B. R. : Je suis responsable du volet vidéo, mais le Creative Cloud recouvre de nombreuses branches de l’activité d’Adobe. Ce dernier trimestre a été particulièrement positif pour nous, et nous avons progressé sur de nouvelles technologies comme Character Animator, qui permet d’animer une image Photoshop ou Illustrator. Notre PDG, Shantanu Narayen, a même fait une démonstration de cette solution à la télévision, en animant en temps réel le présentateur de CNBC, Jim Cramer.

La prochaine étape sera dévoilée lors de la conférence créative Adobe MAX, à l’automne, où nous annoncerons une vaste mise à jour de tous les produits Adobe. De manière générale, nous sommes plus transparents avec nos projets en cours, par exemple avec Adobe XD, que nous développons de manière ouverte, et d’autres logiciels en version bêta publique. C’est une nouvelle approche du développement de logiciels : on ne peut plus s’enfermer dans un bureau et espérer créer un logiciel qui plaira aux utilisateurs, il faut plutôt mettre en place un workflow de base, puis travailler en collaboration avec la communauté.

C’est notre approche, et nous avons prévu une version de Creative Cloud très impressionnante pour cet automne, avec d’importantes évolutions dans tous les domaines et avec l’intégration de la technologie apportée par Mettle. Cela devrait nous permettre de présenter des démonstrations qui inspireront les créateurs.

Nous allons également continuer le travail sur les modèles pour les graphismes animés, afin de réutiliser une séquence produite avec After Effects et de l’ajouter dans un environnement de montage : c’est un atout de taille en termes de branding et d’identité graphique sur des plates-formes comme YouTube ou Facebook, avec lesquelles nous travaillons d’ailleurs en étroite collaboration, notamment sur la VR.

C’est une époque très intéressante, et la vidéo a le vent en poupe ! J’ai découvert la semaine dernière que nous avons enregistré une croissance de 49 % en un an des abonnements à l’application Premiere Pro. La part de la vidéo dans l’utilisation de Creative Cloud est également en croissance, avec de nombreux illustrateurs et photographes qui commencent à se tourner vers la vidéo pour se diversifier. On peut dire que j’ai choisi la bonne carrière au bon moment !

M. : Quelle est la taille de votre équipe de R&D ?

B.R. : Nous n’avons pas fait d’annonce officielle, mais vous seriez surpris de voir à quel point notre équipe vidéo est petite, car notre chef ingénieur David McGavran et ses prédécesseurs ont déployé des efforts énormes pour mettre en place une plate-forme technologique saine, que nous appelons « Media Core » en interne, qui garantit une interopérabilité très poussée de nos différentes technologies.

Nous avons des projets très intéressants qui seront bientôt annoncés, notamment en exploitant la puissance d’un smartphone ordinaire pour nos applications, sans toutefois reprendre toute l’interface d’After Effects, par exemple ! C’est un exemple de piste que nous explorons actuellement, et nous sommes capables de le faire avec une équipe relativement réduite, qui bénéficie de son appartenance à la grande famille Adobe. Lors de la conférence Adobe MAX, je n’ai qu’à produire des solutions de qualité et l’équipe d’Adobe fait un travail d’intégration incroyable.

* Article paru pour la première fois dans Mediakwest #23, p.54-56. Abonnez-vous à Mediakwest (5 nos/an + 1 Hors série « Guide du tournage) pour accéder, dès leur sortie, à nos articles dans leur totalité.